Cuando un grupo de investigadores decidió probar si el “pensamiento positivo” aumentaba la precisión de los chatbots con inteligencia artificial (IA), llegaron a resultados sorprendentes.

Mientras hacían varias preguntas a los chatbots, intentaron llamarlos «inteligentes», los animaron a pensar detenidamente e incluso terminaron sus preguntas con comentarios como: «¡Esto será divertido!».

Nada de esto tuvo un impacto significativo, pero hubo una técnica que se destacó. Cuando hicieron que una IA actuara como si fuera parte de la saga viaje a las estrellasMejora de los conocimientos básicos de matemáticas.

La gente tiene todo tipo de estrategias extrañas para obtener mejores respuestas de los grandes modelos de lenguaje (LLM), la tecnología de inteligencia artificial que subyace a herramientas como ChatGPT.

Algunos juran que la IA funciona mejor cuando la amenazas, otros creen que los chatbots son más cooperativos cuando eres educado y hay quienes piden a los robots que se hagan pasar por expertos en el tema que están discutiendo.

La lista continúa. Es parte de la mitología que rodea la «ingeniería de señales» o la «ingeniería de contexto», diferentes formas de construir instrucciones para que la IA ofrezca mejores resultados.

Esta es la cuestión: los expertos me dicen que gran parte de la sabiduría convencional simplemente no funciona. En algunos casos podrían incluso resultar peligrosos. Pero la forma de hablar con una IA es importante y algunas técnicas realmente marcan la diferencia.

“Mucha gente cree que existen palabras mágicas que permiten a los LLM resolver un problema”, afirma Jules White, profesor de informática que estudia la IA generativa en la Universidad de Vanderbilt (EE.UU.). «Pero no se trata de la elección de las palabras, sino de cómo expresas básicamente lo que estás tratando de hacer».

¿Prestar atención a los modales?

El año pasado un usuario de la red social

Sam Altman, director ejecutivo de OpenAI, la empresa detrás de ChatGPT, respondió: «Decenas de millones de dólares están bien gastados», afirmó. «Nunca se sabe».

La mayoría de la gente interpreta la última línea como una referencia obvia a la idea de un posible apocalipsis de la IA, aunque es difícil saber qué tan en serio tomar esa cifra de «decenas de millones de dólares». Pero la cortesía también es una cuestión práctica.

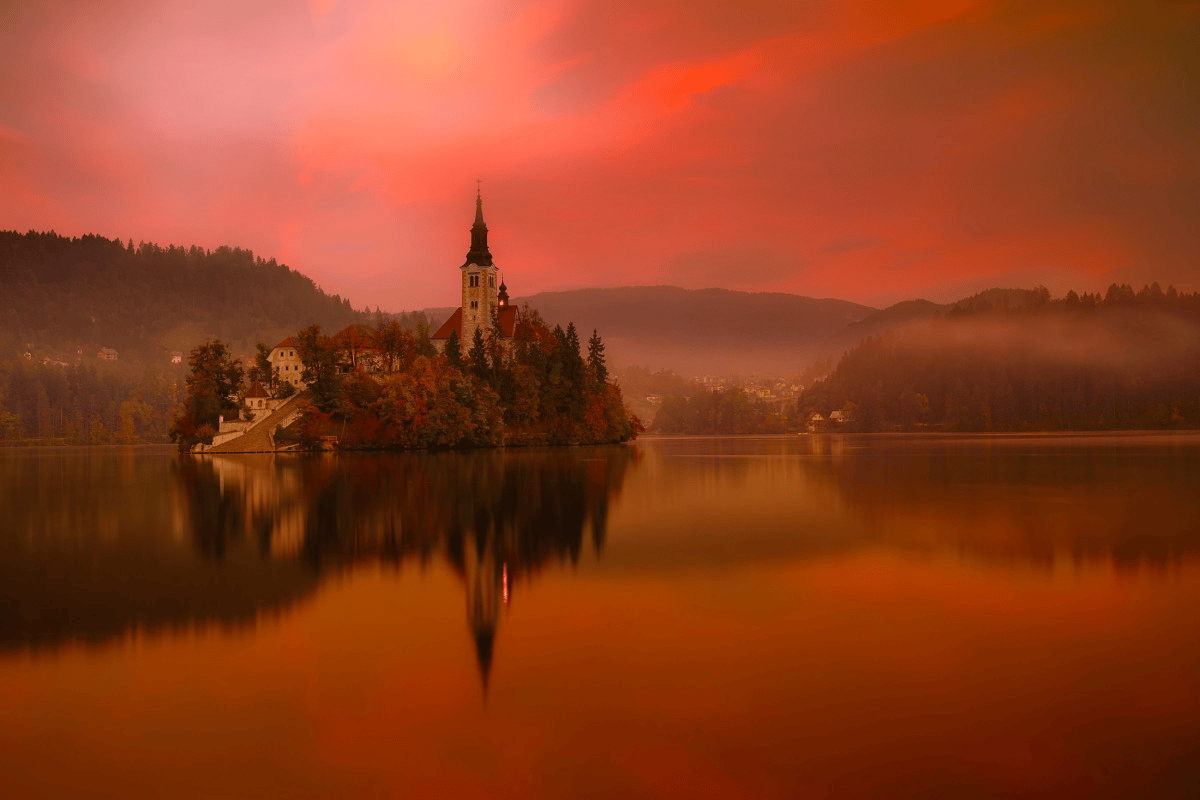

Algunos estudios sugieren que ser amable con la IA conduce a mejores respuestas; otros encuentran lo contrario. (Imágenes falsas)

Los chatbots de LLM funcionan dividiendo sus palabras en pequeños fragmentos llamados «tokens» y luego analizándolos mediante estadísticas para generar una respuesta adecuada.

Esto significa que todo lo que digas, desde la elección de la palabra hasta una coma adicional, influye en cómo responde la IA. El problema es que es extremadamente difícil de predecir.

Se han realizado muchas investigaciones para buscar patrones en pequeños cambios en las señales de la IA, pero gran parte de la evidencia es contradictoria y no concluyente.

Por ejemplo, un estudio de 2024 encontró que los chatbots LLM daban respuestas mejores y más precisas a preguntas educadas en lugar de simplemente dar órdenes.

Lo que era aún más extraño era que había diferencias culturales. En comparación con el chino y el inglés, los chatbots de habla japonesa tuvieron un desempeño ligeramente peor en lo que respecta a la cortesía excesiva.

Pero, en general, no hay suficiente investigación sobre este tema para llegar a conclusiones sólidas. Además, las empresas de inteligencia artificial actualizan constantemente sus chatbots, lo que significa que la investigación puede quedar obsoleta.

Los expertos dicen que los modelos de IA han mejorado dramáticamente en tan solo unos años y técnicas como los halagos, la cortesía, los insultos o las amenazas se han convertido en una pérdida de tiempo cuando el objetivo es hacer que la IA sea más precisa.

Todo lo que digas, desde la elección de una palabra hasta una coma adicional, afecta la forma en que responde la IA. (Imágenes falsas)

Según los expertos, los últimos modelos de IA que se encuentran en todos los productos convencionales, como ChatGPT, Gemini o Claude, son más capaces de capturar las partes más importantes de la lección.

Es poco probable que usted se vea afectado por estos pequeños cambios de lenguaje, al menos no de manera consistente y explotable.

Esto es inquietante a su manera. Las empresas suelen desarrollar IA para comportarse como humanos. Por lo tanto, es lógico que a veces den la impresión de que tienen estados de ánimo o personalidades que pueden controlarse.

Pero no se deje engañar. Las herramientas de IA son imitadores, no seres vivos. Simplemente simulan el comportamiento humano.

Si desea mejores respuestas, deje de tratar a la IA como una persona y comience a tratarla como una herramienta.

Cómo hablar con tu chatbot

La IA presenta problemas muy reales, desde cuestiones éticas hasta su impacto en el medio ambiente. Algunas personas se niegan a interactuar con él en absoluto.

Sin embargo, si decide hacer un LLM, aprender cómo obtener lo que desea de manera más rápida y eficiente es mejor para usted y probablemente para la energía que gasta en hacerlo.

Estos seis consejos le ayudarán a empezar.

Si desea mejores respuestas, deje de tratar a la IA como una persona y comience a tratarla como una herramienta. (Imágenes falsas)

1. Pregunta por múltiples opciones

“Lo primero que le digo a la gente es que pidan no sólo una respuesta, sino tres o cinco”, dice White.

Por ejemplo, si necesitas ayuda con un texto, le indicas a la IA que te ofrezca varias opciones que difieren significativamente. «Obliga a la gente a pensar en lo que les gusta y por qué», explica.

2. Dar ejemplos

Si es posible, proporcione una muestra a la IA. «Por ejemplo, veo personas que le piden a un LLM que escriba un correo electrónico y luego se frustran porque piensan: ‘Eso no suena para nada como yo'», dice White.

El impulso natural es responder con una lista de instrucciones, como «Haz esto» y «No hagas aquello». White dice que es mucho más efectivo decir: «Aquí hay 10 correos electrónicos que envié antes. Utilice mi estilo de escritura».

3. Solicitar una entrevista

«Supongamos que desea crear una descripción de trabajo. Dígale a la IA: ‘Quiero que me haga preguntas, una a la vez, hasta que haya reunido suficiente información para escribir una oferta de trabajo convincente'», explica White.

«Al repasarlo pregunta por pregunta, puedes adaptarlo a tus respuestas».

El impulso natural es darle a la IA una lista de instrucciones (“Haz esto” y “No hagas aquello”), pero es mejor dar ejemplos. (Imágenes falsas)

4. Ten cuidado al jugar roles

«Antes se pensaba que si le decías a la IA que eras, por ejemplo, profesor de matemáticas, respondería las preguntas de matemáticas con mayor precisión», dice Sander Schulhoff, un emprendedor e investigador que ayudó a popularizar la idea de la ingeniería rápida.

Sin embargo, al buscar información o hacer preguntas con una sola respuesta correcta, Schulhoff y otros dicen que los juegos de roles pueden reducir la precisión de los modelos de IA.

«Esto puede ser realmente peligroso», afirmó Rick Battle, ingeniero de aprendizaje automático aplicado en Broadcom y coautor del estudio «Star Trek».

«En realidad estás fomentando la alucinación porque le estás diciendo que es un experto y que debe confiar en su conocimiento paramétrico interno».

Básicamente, esto puede hacer que la IA actúe con exceso de confianza.

Pero para tareas muy abiertas y sin una única respuesta, los juegos de rol son eficaces. Piense en consejos, lluvia de ideas y resolución de problemas creativa o exploratoria.

O si está nervioso por las entrevistas, pedirle a un chatbot que imite a un gerente de contratación podría ser un buen enfoque.

Si está nervioso antes de una entrevista, pedirle a un chatbot que imite a un gerente de contratación podría ser un buen enfoque. (Imágenes falsas)

5. Mantente neutral

«No guíes al testigo», dice Battle. Si estás tratando de decidir entre dos autos, no digas que te inclinas por el Toyota. «De lo contrario, esa es probablemente la respuesta que obtendrás».

6. Por favor y gracias

Según una encuesta del Pew Research Center de 2019, más de la mitad de los estadounidenses dicen «por favor» cuando hablan con sus asistentes inteligentes.

Parece que esta tendencia continúa. Una encuesta realizada en 2025 por la editorial Future encontró que el 70% de las personas tratan la IA con educación cuando la usan. La mayoría dijo que lo hizo porque era lo correcto, aunque el 12% dijo que era necesario para protegerse de los levantamientos de robots.

Es posible que la cortesía no lo proteja de los robots enojados ni haga que los LLM sean más precisos, pero existen otras razones para continuar haciéndolo.

«Para mí, lo más importante es que uno se sienta más cómodo diciendo ‘por favor’ y ‘gracias’ cuando se trata de IA», afirma Schulhoff. «No mejora el rendimiento del modelo, pero si te ayuda a usarlo más a menudo porque te sientes más cómodo, entonces es útil».

También necesitas considerar la sensibilidad de tu propia naturaleza humana. El filósofo Immanuel Kant argumentó que una de las razones por las que uno no debería ser cruel con los animales es porque también es perjudicial para uno mismo.

Básicamente, ser hostil hacia cualquier cosa te convierte en una persona más cruel. No puedes herir los sentimientos de una IA porque no los tiene, pero igual deberías ser amable. Es un hábito que podría beneficiar otros aspectos de tu vida.

*Puedes leer la versión original en inglés de este artículo de BBC Future. Aquí.